OpenAI uruchamia aplikację społecznościową Sora do filmów generowanych przez sztuczną inteligencję, co budzi obawy dotyczące „niedopracowanej sztucznej inteligencji” i praw autorskich

Firma stojąca za ChatGPT wydała we wtorek swoją nową aplikację społecznościową Sora, która ma przyciągnąć uwagę osób oglądających obecnie krótkie filmy na TikToku, YouTube lub należących do Meta Instagramie i Facebooku.

Nowa aplikacja na iPhone'a wykorzystuje atrakcyjność możliwości nagrania samego siebie, w którym robisz niemal wszystko, co sobie wyobrazisz, w stylach od anime po wysoce realistyczne.

Jednak lawina takich filmików zalewająca media społecznościowe budzi obawy, że jest to „śmieciowa sztuczna inteligencja”, która tłumi autentyczną ludzką kreatywność i degraduje ekosystem informacji.

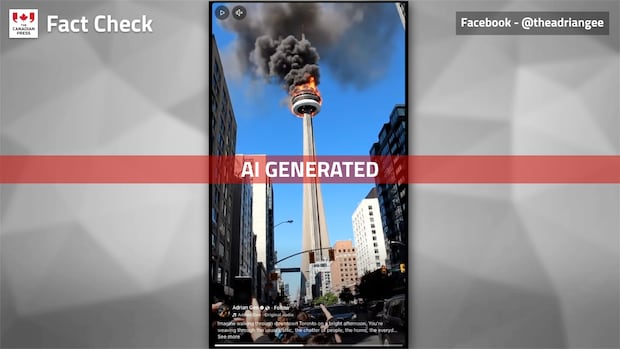

Filmy generowane przez sztuczną inteligencję stały się bardziej zaawansowane wraz z rozwojem technologii – zdolne do oszukiwania widzów. W zeszłym tygodniu na Facebooku pojawił się film z udziałem sztucznej inteligencji, przedstawiający płonącą wieżę CN Tower . Niektórzy użytkownicy byli zszokowani, myśląc, że nagranie jest prawdziwe. Od niewinnych filmów z królikami skaczącymi na trampolinach , po deepfake'i z rzekomych scen pożarów, użytkownicy mediów społecznościowych zostali oszukani.

Oficjalny film z premiery aplikacji Sora przedstawia wygenerowaną przez sztuczną inteligencję wersję CEO OpenAI, Sama Altmana, przemawiającego z psychodelicznego lasu, księżyca i stadionu wypełnionego kibicami oglądającymi wyścigi gumowych kaczek. Przedstawia nowe narzędzie, a następnie przekazuje je współpracownikom, którzy znaleźli się w innych, niecodziennych sytuacjach. Aplikacja jest na razie dostępna tylko na urządzeniach Apple, począwszy od Stanów Zjednoczonych i Kanady.

W zeszłym tygodniu Meta uruchomiła w swojej aplikacji Meta AI własny kanał krótkich filmów o sztucznej inteligencji. W poście na Instagramie, zapowiadającym nowy produkt Vibes, prezes Meta, Mark Zuckerberg, opublikował karuzelę filmów o sztucznej inteligencji, w tym kreskówkową wersję siebie, armię puszystych, paciorkowatych istot skaczących dookoła oraz kociaka ugniatającego kulkę ciasta.

Zarówno Sora, jak i Vibes zostały zaprojektowane tak, aby były wysoce spersonalizowane i rekomendowały nowe filmy na podstawie tego, z czym użytkownicy już się zapoznali.

Jose Marichal, profesor nauk politycznych na California Lutheran University, który bada, jak sztuczna inteligencja restrukturyzuje społeczeństwo, twierdzi, że jego własne kanały w mediach społecznościowych, na TikToku i innych stronach, są już pełne takich filmów, od „domowego kota jadącego na dzikim zwierzęciu z perspektywy kamery przy dzwonku do drzwi” po fałszywe doniesienia o klęskach żywiołowych, które są angażujące, ale łatwe do obalenia. Powiedział, że nie można winić ludzi za to, że są tak zaprogramowani, by „wiedzieć, czy na świecie dzieje się coś niezwykłego”.

Jego zdaniem, niebezpieczne jest to, że dominują one w tym, co widzimy w Internecie.

„Potrzebujemy środowiska informacyjnego, które w większości będzie prawdziwe lub któremu możemy zaufać, ponieważ musimy je wykorzystać do podejmowania racjonalnych decyzji o tym, jak wspólnie rządzić” – powiedział.

W przeciwnym razie „albo stajemy się super, super sceptyczni wobec wszystkiego, albo super pewni” – powiedział Marichal. „Albo jesteśmy manipulowani, albo manipulatorami. A to prowadzi nas w stronę czegoś innego niż liberalna demokracja, innego niż demokracja przedstawicielska”.

OpenAI w swoim ogłoszeniu z wtorku podjęło pewne działania mające na celu rozwianie tych obaw.

„Obawy związane z doomscrollingiem, uzależnieniem, izolacją i [uczeniem się przez wzmacnianie] zoptymalizowanymi kanałami są priorytetem” – napisano we wpisie na blogu . Firma poinformowała, że będzie „okresowo przeprowadzać ankiety dotyczące samopoczucia użytkowników” i dawać im możliwość dostosowania kanału, z wbudowaną opcją polecania postów znajomym, a nie obcym.

Treści chronione prawem autorskim w SoraSora pozwala również użytkownikom na wykorzystywanie materiałów wideo chronionych prawem autorskim — co z pewnością wywoła oburzenie w Hollywood.

Właściciele praw autorskich, tacy jak studia telewizyjne i filmowe, muszą zrezygnować z wyświetlania swoich prac w materiale wideo – poinformowali przedstawiciele firmy, opisując to jako kontynuację poprzedniej polityki firmy dotyczącej generowania obrazu.

Przedstawiciele firmy poinformowali, że twórca ChatGPT prowadził w ostatnich tygodniach rozmowy z różnymi posiadaczami praw autorskich w celu omówienia tej polityki. Co najmniej jedno duże studio, Disney, zrezygnowało już z publikowania swoich materiałów w aplikacji, jak twierdzą osoby zaznajomione ze sprawą. Na początku tego roku OpenAI naciskało na administrację Trumpa, aby ogłosiła, że trenowanie modeli AI na materiałach chronionych prawem autorskim podlega zasadzie „dozwolonego użytku” w prawie autorskim.

„Stosowanie doktryny dozwolonego użytku do sztucznej inteligencji to nie tylko kwestia amerykańskiej konkurencyjności – to kwestia bezpieczeństwa narodowego” – argumentowała OpenAI w marcu. Według ówczesnej organizacji, bez tego kroku amerykańskie firmy zajmujące się sztuczną inteligencją straciłyby przewagę nad konkurentami w Chinach.

Przedstawiciele OpenAI poinformowali, że wdrożyli środki blokujące możliwość tworzenia filmów z udziałem osób publicznych lub innych użytkowników aplikacji bez ich zgody. Podobizny osób publicznych i innych osób nie mogą być wykorzystywane, dopóki nie prześlą one własnego filmu wygenerowanego przez sztuczną inteligencję i nie wyrażą na to zgody.

Jednym z takich kroków jest „weryfikacja żywotności”, w której aplikacja prosi użytkownika o poruszanie głową w różnych kierunkach i recytowanie losowego ciągu liczb. Użytkownicy będą mogli przeglądać wersje robocze filmów, w których występuje ich podobizny.

cbc.ca